Сайт

Сайт

Категорія

GPT-3 Alternative Large Language Models (LLMs)Залишилось редагувати: 700

Наступний додаток

Chinese LLaMA & Alpaca LLMsChinchilla by DeepMind

Конкурент GPT-3 від Deepmind

Про Chinchilla by DeepMind

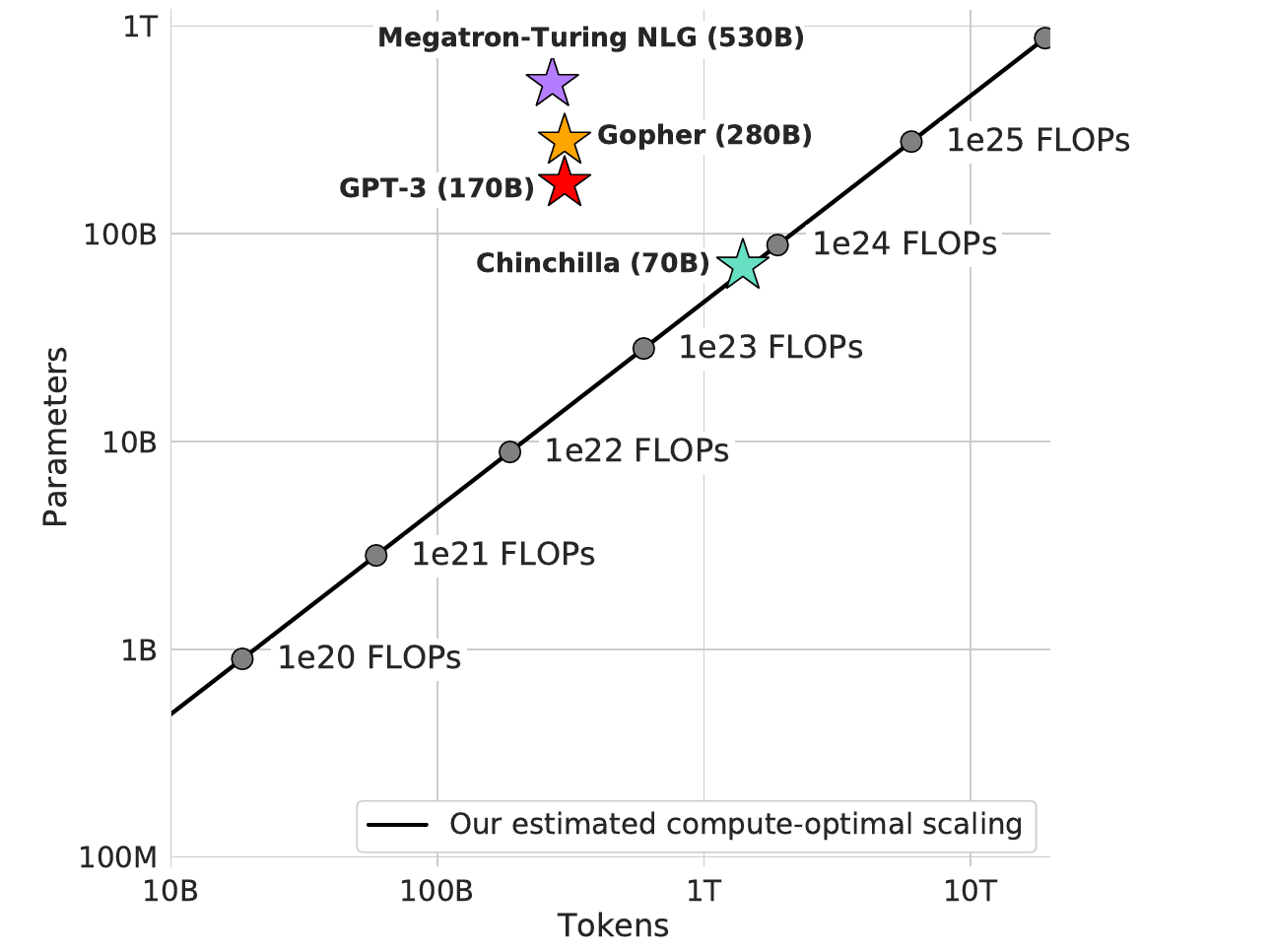

Дослідники DeepMind представили нову модель прогнозування, оптимізовану для обчислювальних задач, під назвою Chinchilla. Вона працює з такою ж потужністю обчислення, що й Gopher, але має 70 мільярдів параметрів та в 4 рази більше даних.

Chinchilla продемонструвала кращі результати, ніж Gopher (280B), GPT-3 (175B), Jurassic-1 (178B) та Megatron-Turing NLG (530B) у широкому спектрі тестів. Вона вимагає значно менше обчислень для налаштування та інференсу, що полегшує використання на практиці.

Chinchilla показала середню точність 67,5%, найкращий результат на сьогодні, на тесті MMLU, що становить 7% покращення порівняно з Gopher.

Найпопулярнішим трендом у навчанні великих мовних моделей було збільшення їх розміру без збільшення кількості токенів, використовуваних для навчання. Найбільший густий трансформер, MT-NLG 530B, зараз втричі більший за GPT-3 з його 170 мільярдами параметрів.

Джерело: https://analyticsindiamag.com/deepmind-launches-gpt-3-rival-chinchilla/

Скріншоти Chinchilla by DeepMind

Читати англійською

Все про GPT-3

Все про GPT-3